内容目录

- • MIA方法概述 🔍

- —— 什么是MIA?

- —— 关键组件解析

- • 实现细节与技术要点 ✨

- —— 数据预处理

- —— 模型训练策略

- • 工程应用案例 🛠️

- —— 文本生成任务

- —— 时间序列预测

- —— 语音识别系统

- • 常见问题及解决方案 ❓

- —— Q1: 如何评估MIA优化效果?

- —— Q2: 遇到兼容性问题怎么办?

- —— Q3: 性能调优需要注意哪些方面?

- • 实用技巧与提示 ✨

- —— 调试与验证

- —— 社区交流

- —— 持续学习

- • 结论

循环神经网络(RNN)作为处理序列数据的强大工具,在自然语言处理、时间序列预测等领域有着广泛应用。然而,传统的RNN在面对长序列时容易出现梯度消失等问题,并且计算效率较低。为了克服这些挑战,研究人员提出了多种优化策略和技术。本文将聚焦于一种名为MIA(Model Inference Acceleration)的方法,详细介绍其原理及实现步骤。

![图片[1]-RNN模型训练与推理优化:MIA方法的深入解析-连界优站](https://www.6x66.cn/wp-content/uploads/2024/12/20230830.png)

MIA方法概述 🔍

什么是MIA?

MIA是一种旨在加速RNN模型推理过程的技术框架。它通过引入一系列创新性的算法改进和硬件优化手段,在保持原有精度的同时显著提升了运行速度。具体来说,MIA主要涵盖以下几个方面:

- 量化技术 – 将浮点数参数转换为低精度整型表示,减少存储需求并加快运算。

- 剪枝策略 – 移除对输出贡献较小的权重连接,简化网络结构以降低复杂度。

- 并行计算 – 利用多核CPU/GPU资源进行任务分解,充分发挥现代硬件性能优势。

关键组件解析

- 量化器模块 – 负责执行从浮点到定点的转换操作,同时保证模型质量不受明显影响。

- 剪枝器模块 – 自动识别冗余连接并加以移除,维持网络拓扑稳定性和功能完整性。

- 调度器模块 – 根据不同设备特性分配最优的工作负载,确保整体吞吐量最大化。

实现细节与技术要点 ✨

数据预处理

为了使MIA能够有效地工作,输入数据必须经过适当的预处理:

- 归一化特征值 – 确保所有输入变量处于相似的数量级,有助于提高收敛速度和泛化能力。

- 填充缺失值 – 对于不完整的序列,采用合理的填补方案来保持一致性。

- 划分训练集与验证集 – 合理分配样本比例,避免过拟合现象的发生。

模型训练策略

- 损失函数选择 – 根据具体任务确定合适的优化目标,如分类问题常用的交叉熵损失。

- 正则化方法 – 添加L2惩罚项或Dropout层防止过拟合现象发生。

- 批量归一化 – 加速收敛速度并提高泛化性能。

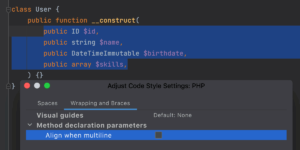

示例代码:构建简单的RNN模型并应用MIA

import torch

import torch.nn as nn

from mia_framework import Quantizer, Pruner, Scheduler

class SimpleRNN(nn.Module):

def __init__(self, input_size, hidden_size, output_size):

super(SimpleRNN, self).__init__()

self.rnn = nn.RNN(input_size, hidden_size, batch_first=True)

self.fc = nn.Linear(hidden_size, output_size)

def forward(self, x):

out, _ = self.rnn(x)

out = self.fc(out[:, -1, :])

return out

# 初始化模型实例

model = SimpleRNN(input_size=10, hidden_size=20, output_size=5)

# 创建MIA组件对象

quantizer = Quantizer()

pruner = Pruner()

scheduler = Scheduler()

# 应用MIA优化

optimized_model = quantizer.optimize(model)

pruned_model = pruner.prune(optimized_model)

final_model = scheduler.schedule(pruned_model)工程应用案例 🛠️

文本生成任务

利用MIA优化后的RNN模型可以快速生成高质量的文章段落或者诗歌作品,满足个性化创作的需求。

时间序列预测

对于股票价格、天气变化等动态数据的建模,MIA能够在不影响准确性的前提下极大缩短预测所需的时间,提供实时决策支持。

语音识别系统

结合端到端的深度学习架构,MIA帮助构建高效的自动语音识别引擎,适用于智能家居、智能客服等多种场景。

常见问题及解决方案 ❓

Q1: 如何评估MIA优化效果?

可以通过对比原始模型和优化后模型的各项指标(如推理速度、内存占用、准确率等),综合判断MIA带来的增益。此外,还可以参考用户反馈意见,不断改进和完善现有方案。

Q2: 遇到兼容性问题怎么办?

确保所使用的深度学习框架版本与其他依赖项相匹配非常重要。对于某些较新的功能,可能需要更新至最新稳定版或者等待官方发布补丁修复。此外,仔细阅读文档并参考社区论坛上的讨论往往能帮助快速定位并解决问题。

Q3: 性能调优需要注意哪些方面?

除了上述提到的技术层面之外,还有许多其他因素也会影响最终性能,如批量大小、学习率设置、硬件配置等。因此,在实际操作过程中应当综合考虑各种变量,不断试验找到最优参数组合。

实用技巧与提示 ✨

调试与验证

开发过程中应建立严格的测试流程,包括单元测试、集成测试以及端到端测试,确保各个部分都能正常运作。同时,积极收集反馈意见,不断优化现有方案。

社区交流

积极参与国内外知名的技术论坛(如GitHub Issues、Stack Overflow),与其他开发者分享经验和心得。订阅相关领域的顶级期刊杂志,保持对前沿研究的关注度。

持续学习

随着深度学习领域日新月异的变化,保持对新技术的关注至关重要。定期查阅官方文档、参加在线课程或研讨会都是不错的选择,有助于紧跟潮流并应用于实践当中。

结论

通过对MIA方法及其在RNN模型训练与推理优化中应用的详细讲解,我们不仅了解到了这种先进框架背后的理论基础,还掌握了如何将其应用于解决实际问题的具体步骤。希望这篇文章能为你带来新的思路和技术支持。如果有任何疑问或需要进一步的帮助,请随时留言讨论!💬

暂无评论内容